在今天上午的一次虚拟活动中,Meta揭开了其为AI工作负载开发内部基础设施的努力的帷幕,包括支持其最近推出的广告设计和创作工具的生成AI类型。

这是对Meta实力投射的一次尝试,Meta在采用AI友好的硬件系统方面历来进展缓慢,这阻碍了其与谷歌和微软等竞争对手保持同步的能力。

“构建我们自己的 [硬件] 功能使我们能够控制堆栈的每一层,从数据中心设计到培训框架,”Meta基础设施副总裁 Alexis Bjorlin告诉TechCrunch。“需要这种水平的垂直整合才能大规模突破人工智能研究的界限。”

在过去十年左右的时间里,Meta花费了数十亿美元来招募顶级数据科学家并构建新型人工智能,包括现在为发现引擎、审核过滤器和遍布其应用程序和服务的广告推荐器提供支持的人工智能。但该公司一直在努力将其许多雄心勃勃的AI研究创新转化为产品,尤其是在生成AI方面。

直到2022年,Meta主要使用CPU和专为加速AI算法而设计的定制芯片的组合来运行其AI工作负载——CPU在处理这类任务时的效率往往低于GPU。Meta取消了计划于 2022 年大规模推出定制芯片的计划,转而订购了价值数十亿美元的Nvidia GPU,这需要对其多个数据中心进行重大重新设计。

为了扭转局面,Meta计划开始开发更具雄心的内部芯片,该芯片将于2025年推出,能够训练AI模型并运行它们。这就是今天演讲的主题。

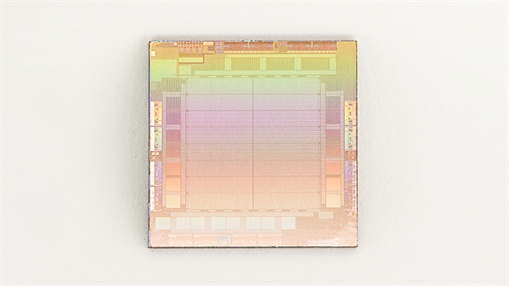

Meta将新芯片称为 MetaTraining and Inference Accelerator,简称MTIA,并将其描述为加速AI训练和推理工作负载的芯片“家族”的一部分。(“推理”是指运行经过训练的模型。)MTIA是一种ASIC,一种将不同电路组合在一块板上的芯片,允许对其进行编程以并行执行一项或多项任务。

“为了在我们的重要工作负载中获得更高水平的效率和性能,我们需要一个与模型、软件堆栈和系统硬件共同设计的定制解决方案,”Bjorlin 继续说道。“这通过各种服务为我们的用户提供了更好的体验。”

定制AI芯片越来越成为大型科技公司的游戏名称。谷歌创建了一个处理器,TPU(“张量处理单元”的缩写),用于训练大型生成式人工智能系统,如PaLM-2和Imagen。亚马逊向AWS客户提供专有芯片,用于训练(Trainium)和推理( Inferentia)。据报道,微软正在与AMD合作开发一种名为Athena的内部AI芯片。

Meta表示,它在2020年创建了第一代 MTIA——MTIA v1——基于7纳米工艺。它可以从其内部 128 MB 内存扩展到高达128GB,并且在Meta设计的基准测试中——当然,必须持保留态度——Meta声称 MTIA 处理了“低复杂性” ”和“中等复杂度”的AI模型比GPU更高效。

Meta说,芯片的内存和网络领域还有很多工作要做,随着AI模型规模的增长,这会出现瓶颈,需要将工作负载分配到多个芯片上。(并非巧合,Meta最近收购了位于奥斯陆的英国芯片独角兽Graphcore的AI网络技术团队。目前,MTI的重点完全放在 Meta应用程序系列“推荐工作负载”的推理上,而不是训练上。

但 Meta强调,它继续改进的MTIA在运行推荐工作负载时“大大”提高了公司在每瓦性能方面的效率——反过来允许 Meta运行“更加增强”和“尖端”(表面上)人工智能工作负载。

也许有一天,Meta会将其大部分人工智能工作负载委托给MTIA银行。但就目前而言,该社交网络在其专注于研究的超级计算机Research SuperCluster (RSC)中依赖GPU。

RSC于2022年1月首次亮相,与Penguin Computing、Nvidia和Pure Storage合作组装而成,已经完成了第二阶段的扩建。Meta表示,它现在包含总共2,000个Nvidia DGX A100系统,配备16,000个Nvidia A100 GPU。

那么为什么要建造一台内部超级计算机呢?嗯,一方面,有同龄人的压力。几年前,微软对其与 OpenAI合作构建的AI超级计算机进行了重大调整,最近又表示将与Nvidia合作,在Azure云中构建新的AI超级计算机。在其他地方,谷歌一直在宣传自己的专注于人工智能的超级计算机,它拥有26,000个Nvidia H100 GPU——领先于 Meta。

但除了跟上竞争对手之外,Meta表示 RSC 的好处是允许其研究人员使用 Meta生产系统中的真实示例来训练模型。这与该公司之前的AI基础设施不同,后者仅利用开源和公开可用的数据集。

“RSCAI超级计算机用于在多个领域推动AI研究的边界,包括生成AI,”Meta发言人说。“这真的关系到人工智能研究的生产力。我们希望为AI研究人员提供最先进的基础设施,使他们能够开发模型并为他们提供培训平台以推进AI发展。”

在其巅峰时期,RSC可以达到近5 exaflops的计算能力,该公司声称这使其成为世界上最快的计算能力之一。(为了避免给人留下深刻印象,值得注意的是,一些专家对exaflops性能指标持保留态度,并且 RSC 远远超过世界上许多最快的超级计算机。)

Meta表示,它使用RSC来训练 LLaMA,这是“大型语言模型元人工智能”的首字母缩写词——该公司在今年早些时候作为“门控发布”向研究人员共享的大型语言模型(随后以各种形式泄露)互联网社区)。Meta表示,最大的 LLaMA 模型在 2,048个A100 GPU上进行了训练,耗时21天。

“构建我们自己的超级计算能力使我们能够控制堆栈的每一层;从数据中心设计到培训框架,”发言人补充道。“RSC 将帮助 Meta的AI研究人员构建新的更好的AI模型,这些模型可以从数万亿个示例中学习;跨数百种不同的语言工作;一起无缝分析文本、图像和视频;开发新的增强现实工具;以及更多。”

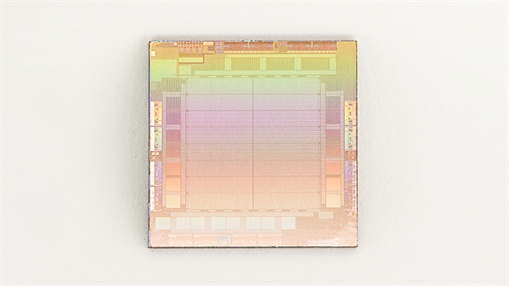

该公司在今天的活动中透露,除了MTIA之外,Meta还在开发另一种芯片来处理特定类型的计算工作负载。该芯片称为 Meta可扩展视频处理器(MSVP),是Meta首款内部开发的 ASIC 解决方案,专为满足视频点播和直播流媒体的处理需求而设计。

读者可能还记得, Meta多年前就开始构思定制服务器端视频芯片,并宣布在2019年推出用于视频转码和推理工作的 ASIC。这是其中一些努力的成果,也是对竞争优势的新推动。特别是现场视频领域。

“仅在Facebook上,人们就将50% 的时间花在观看视频上,”Meta技术主管Harikrishna Reddy和Yunqing Chen在今天上午发表的一篇合着的博客文章中写道。“为了服务于世界各地的各种设备(移动设备、笔记本电脑、电视等),上传到 Facebook 或 Instagram 的视频被转码为多个比特流,具有不同的编码格式、分辨率和质量……MSVP是可编程和可扩展的,并且可以配置为有效地支持VOD所需的高质量转码以及实时流媒体所需的低延迟和更快的处理时间。”

Meta的定制芯片旨在加速视频工作负载,例如流媒体和转码。图片学分:元

Meta表示,它的计划是最终将大部分“稳定和成熟”的视频处理工作负载卸载到MSVP,并仅对需要特定定制和“显着”更高质量的工作负载使用软件视频编码。Meta说,使用智能降噪和图像增强等预处理方法以及伪影去除和超分辨率等后处理方法,我们将继续使用 MSVP 提高视频质量。

“在未来,MSVP将使我们能够支持更多Meta最重要的用例和需求,包括短视频——实现生成AI、AR/VR 和其他元宇宙内容的高效交付,”Reddy和Chen说。

如果今天的硬件公告有一个共同点,那就是 Meta拼命地试图加快与AI相关的步伐,特别是生成AI。

之前已经电报了很多。今年2月,首席执行官马克扎克伯格——据报道已将提高 Meta的人工智能计算能力作为首要任务——宣布了一个新的顶级生成人工智能团队,用他的话说,“涡轮增压”公司的研发。首席技术官安德鲁博斯沃思最近同样表示,生成人工智能是他和扎克伯格花费最多时间的领域。首席科学家Yann LeCun表示,Meta计划部署生成式AI工具来在虚拟现实中创建项目。

“我们正在探索WhatsApp和Messenger中的聊天体验、Facebook和Instagram帖子和广告的视觉创建工具,以及随着时间的推移视频和多模式体验,”扎克伯格在4月份 Meta第一季度财报电话会议上表示。“我希望这些工具对从普通人到创作者再到企业的每个人都有价值。例如,我预计一旦我们确定了这种体验,人们就会对用于业务消息传递和客户支持的AI代理产生很大兴趣。随着时间的推移,这也将扩展到我们在元宇宙上的工作,在那里人们将能够更容易地创建化身、对象、世界和将所有这些联系在一起的代码。”

在某种程度上,Meta感到来自投资者的压力越来越大,他们担心该公司的行动速度不够快,无法占领(潜在的大)生成人工智能市场。它对像Bard、Bing Chat或ChatGPT这样的聊天机器人还没有答案。它在图像生成方面也没有取得太大进展,这是另一个出现爆炸性增长的关键领域。

如果预测正确,生成式AI软件的总潜在市场可能达到1500亿美元。高盛预测它将使GDP增长7%。

即使是其中的一小部分,也可以消除 Meta在增强现实耳机、会议软件和 Horizon Worlds等VR游乐场等“元宇宙”技术投资中损失的数十亿美元。Meta负责增强现实技术的部门Reality Labs上季度报告净亏损40亿美元,该公司在第一季度电话会议上表示,预计“2023年运营亏损将同比增加”。